2026 está siendo un quebradero de cabeza para todos los departamentos de IT, desde Sistemas hasta desarrollo pasando, cómo no, por ciberseguridad, y gran parte viene del uso de Agentes IA sin control por parte de las corporaciones.

Esto es debido a que desde la aparición más o menos masiva a mitad de 2024, ha habido una explosión de Agentes de IA en 2025 y que en los primeros meses 2026, lo estamos viendo en todas las organizaciones, da igual del tamaño y vertical en la cual estén operando (Sabiendo que algunos sectores son más valientes para adoptar ciertas tecnologías).

Qué es el Shadow IA, pues básicamente es el uso de IA en sus diferentes usos y sabores, sin que la compañía pueda evaluar el uso que se está realizando y sobre todo, que información se comparte con el agente y hasta dónde se puede llegar a exponer cierta información confidencial al público.

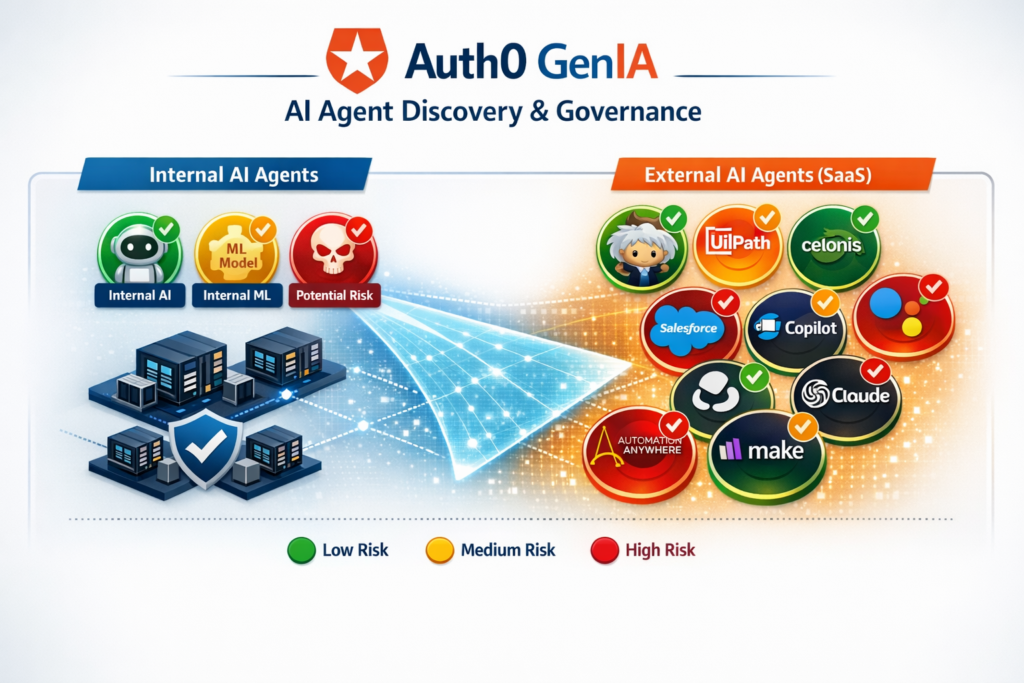

Desde mi punto de vista, tenemos varios tipos de Agentes IA y para cada uno de ellos, debemos de asegurar que se está gestionando de la forma correcta, no desde las divisiones de negocio (las que más uso están haciendo), sino también desde las divisiones de IT, cómo infraestructura para gestionar el consumo de uso de este tipo de tecnología, ya sea en cloud privadas como públicas ya que según los recursos de la compañía podría afectar muchísimo a otras unidades o peor todavía, a producción en donde un desvío en tiempo, modificaciones de planificación, o sobrecarga de los recursos disponible, puede hacer perder mucho capital a la compañía.

¿Qué tipos de Agentes IA tenemos?

- Empresariales Riesgo Alto: Con posibilidad de manipular información empresarial de diferentes fuentes de información y por lo tanto, con un acceso privilegiado a información sensible. En este caso, fabricantes de IA cómo UiPath, OpenIA, Celonis, Blue&Prism los categorizarían ya que gracias a las posibilidades de RPA (origen de muchos de estas soluciones), están integradas en la operativa diaria de la compañía sin tener un gran control sobre ellas.

- Empresariales Riesgo Medio: Son aquellas que provienen de entornos comerciales, pero que normalmente sólo actúan dentro de un ecosistema conocido, cómo puede ser AgentForce, Embat o aquellos vienen desde CRM/ERP o sistemas de nicho.

- Públicas: Estas son las que más me asustan, por hasta dónde pueden llegar y que pueden llegar hacer en la organización, aquí entraría mucho Open Source y de muy bajo coste que finalmente compartes cierta información con otros usuarios.

¿Cuál es el reto?

El primero y más importante, antes de que se vaya de madre toda la IA dentro de la compañía, es realizar un Descubrimiento de aquellos agentes IA que se están utilizando en la organización, ya sean:

- Provistos por la compañía: cómo podría ser CoPilot de Microsoft, o cualquier Agente de IA de Riesgo Alto y muchos de Riesgo Medio, en donde su uso está más o menos aceptado, pero falta una parte de gestión y securización por parte de CISO/IT y no sirve el uso de MCP o RAG para guiar hacia que recursos puede ir a consultar.

- Usados por los empleados: este escenario, es como cuando veíamos en los 90 «Viernes 13», aterrador, ya que es evidente el poco control que tiene la compañía sobre los recursos que debería de mantener.

Para ambos entornos, debemos tener claro, si deben de ser utilizados o no y es necesario disponer de herramientas que sean capaces de descubrir el uso, ya sea desde una aplicación como Copilot que puede integrar otros fabricantes para ser un punto único de consulta, como aquellas que se utilizan desde el navegador (ChatGPT, Claude, ClawdBot….)

Con Auth0 for GenIA, 2 funciones que me gustan muchísimo es la Discovery para identificar todos los motores de IA y desde donde se ejecutan/consultan y Gobierno de IA, para decir según necesidades de la organización, dónde puede acceder y dónde no será posible consultar información.

Así que si queréis más información, me dáis un toque o vais a https://auth0.com/ai para conocer más sobre la solución.